Début mai, Google a mis en ligne une modification de son algorithme de référencement naturel, comme plusieurs centaines de fois par an. Mais cette fois-ci le changement a été fortement ressenti par de nombreux webmasters et emarketers. Certains ont connu une baisse soudaine de près de 20% et bien entendu d'autres ont au contraire bénéficié de fortes augmentation de trafic. Vous trouverez dans cet article des explications sur ces changements d'algo de Google, qui devraient avoir un impact assez fort dans les mois et années à venir, notamment sur l'optimisation de la longue traîne (Long Tail).

Auteur/autrice : Olivier Duffez

Voici un petit quiz de référencement naturel orienté R&D, algorithmes des moteurs de recherche, information retrieval. Saurez-vous répondre correctement à toutes les questions ? Attention c'est loin d'être facile...

Parmi les nombreuses extensions Firefox d'aide au référencement, SEO Quake figure en bonne place depuis déjà longtemps. Voici donc un tutoriel SeoQuake très complet...

Jusqu'à présent, le nom officiel du robot du moteur de recherche de Microsoft n'a pas évolué aussi rapidement que les noms du moteur : il s'appelle toujours msnbot, du nom de MSN Search, l'ancêtre de Live Search, celui-là même qui a engendré l'actuel Bing :-) A partir du 1er octobre 2010 le nom d'agent sera donc Bingbot.

Il vous est peut-être déjà arrivé d'avoir un grand nombre de pages sur votre site qui disparaissent et génèrent donc des erreurs 404 (Page introuvable). Est-ce nuisible pour votre visibilité dans Google ? A priori non... explications !

Extensions Chrome pour le web sémantique (RDF, XFN, microformats, meta)

Voici 3 extensions Chrome qui pourraient vous aider si vous vous intéressez au web sémantique (ou à ses balbutiements si vous préférez).

Ce tutoriel explique comment créer un compte @yandex.ru pour accéder aux outils destinés aux webmasters, puis comment ajouter un site. Enfin il détail quelques fonctionnalités inédites de Yandex.

Jusqu'à présent, Google ne personnalisait les résultats (en fonction de l'historique des recherches de l'utilisateur) qu'à la double condition qu'à la création de son compte Google, l'utilisateur ait coché la case autorisant Google à conserver cet historique, et qu'il soit connecté à ce compte pour effectuer ses recherches. Désormais Google personnalise les SERP pour tout le monde. Autant dire que ça va modifier quelques habitudes chez les référenceurs...

Le cloaking est une technique qui consiste à configurer un site web pour que le contenu d'une page diffère selon le type d'utilisateur qui cherche à la consulter. Les moteurs interdisent cette pratique dès lors que le contenu fourni aux robots est différent de celui fourni aux internautes. Voici quelques cas particuliers commentés par Google...

Google change sa gestion des liens nofollow : la fin du PR sculpting

Google vient de lâcher une info qui fait grand bruit depuis plusieurs jours, mais qui ne me semble pas exprimée assez clairement pour que l'on sache vraiment quoi conclure. D'ailleurs certains ont réagi un peu trop rapidement il me semble, annonçant la fin de la prise en compte par Google des liens nofollow... D'après ce que Matt Cutts aurait annoncé, la popularité qu'une page peut transmettre serait désormais fonction du nombre total de liens sortants (follow + nofollow) alors que jusqu'à présent elle dépendait du nombre de liens follow. Dit autrement, ajouter des liens nofollow sur une page gaspille de la popularité à distribuer alors qu'avant elle l'économisait. C'est donc sans doute la fin du PageRank sculpting basé sur l'attribut nofollow. Cet article tente d'y voir plus clair avec un certain nombre d'explications et d'exemples...

Les Rich Snippets de Google, basés sur l'analyse des données web structurées

Depuis le temps que les spécialistes du secteur se demandaient pourquoi Google n'exploitait pas plus les données structurées ! Google vient d'annoncer qu'ils allaient utiliser les 2 principaux formats de marquage de données structurées (les microformats et le standard RDFa) pour afficher certains résultats de manière enrichie : note moyenne et nombre d'avis par les consommateurs, adresse d'une entreprise, etc. Un petit pas vers le web sémantique... Cet article détaille tout cela et explique comment les webmasters doivent mettre à jour leurs sites pour en tirer profit.

Google tient compte des mots-clés dans l'URL, mais leur impact est moins fort que vous le pensez

Conseils d'optimisation des URL pour le référencement : quelle est l'importance réelle de la présence de mots-clés dans l'URL ? Explications par Olivier Duffez.

Certains sites utilisent encore des adresses sans nom de domaine propre, utilisant les services (gratuits) d'un fournisseur d'accès ou d'une plateforme de blogs, forums, wiki, etc. Pour le référencement c'est parfois la catastrophe car l'adresse du site peut changer plusieurs fois, selon les humeurs du prestataire. Voici un exemple et quelques explications...

Gestion singulier/pluriel dans le référencement (algo Google)

Comment les moteurs de recherche tiennent-ils compte des différentes formes d'un mot (singulier/pluriel) ? Nous savons bien que les moteurs repèrent la racine commune du mot (stemming), si bien qu'en utilisant le singulier sur une page, on peut bien sortir dans les résultats pour une requête au pluriel (et réciproquement). L'attribution d'un brevet sur la question à Yahoo est l'occasion de revenir sur ce sujet d'étude du référencement...

A l'origine un terme utilisé uniquement par quelques fans de Google, parmi les webmasters passionnés de référencement et les référenceurs professionnels, la Google Dance était début 2000 un événement incontournable des SEO. Il a désormais disparu, en voici l'historique.

Cet article présente la notion de blacklistage (blacklisting) de Google et indique ce qu'il faut faire si votre site est ainsi banni de l'index Google.

Pour indexer des millions de pages tous les jours, Google utilise une "armée" de robots d'indexation, appelés GoogleBot (lire l'étude sur GoogleBot pour en savoir plus). A chaque fois qu'un de ces robots visite une page, il la récupère et la stocke sur un des serveurs de Google. Cette version du document est appelée la version cache. On comprend vite qu'avec des milliards de documents Google ait besoin de plus de 10 000 serveurs (et beaucoup de disques durs...).

Les milliers de serveurs de Google sont répartis sur des centres de données, appelés Data Centers. Voici la liste des premiers data centers de Google...

Priyank Garg, directeur de Yahoo Search, répond aux questions d'Eric Enge à propos de l'importance des liens dans l'algorithme de Yahoo Search, de la politique de Yahoo concernant l'achat et la vente de liens, de la lutte contre le spamdexing, les balises meta robots noindex et nofollow, et enfin de la classe robots-nocontent...

Utiliser PHP sur son site pose-t-il un problème pour le référencement ? Cet article explique que ce n'est pas le cas et donne quelques conseils associés.

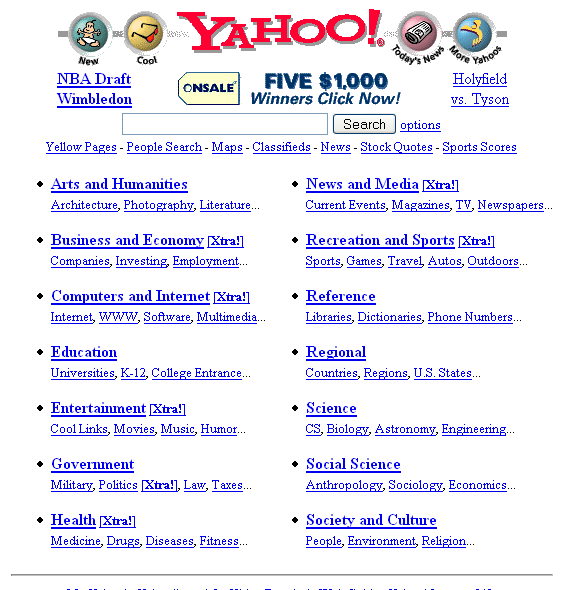

L'annuaire Yahoo!, créé en 1994, a fermé définitivement fin 2014

Yahoo!, créateur de l'annuaire le plus célèbre d'Internet, l'a finalement supprimé le 31/12/2014, après 20 ans de services... Cet article rappelle ce qu'a été l'annuaire Yahoo et le rôle qu'il a joué dans le référencement.

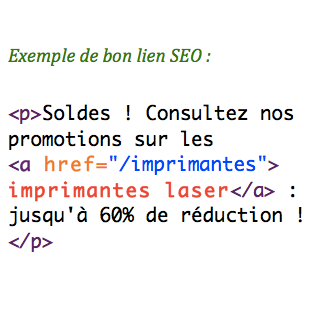

Obtenir des liens est essentiel, mais il est souvent indispensable de faire des liens externes (vers d'autres sites). Voici des conseils pour vos liens sortants externes.

Quand Google a bâti son algorithme, le moteur de recherche vedette de l'époque, Altavista, ne se basait quasiment que sur le texte d'une page pour juger de sa pertinence pour une requête donnée. Les fondateurs de Google ont bouleversé la donne en se basant également sur des données extérieures à la page. Parmi ces données figure bien entendu le PageRank (pour estimer la popularité de la page sur le web) mais aussi le contexte sémantique issu des liens.

Une page type pour le référencement est assez facile à décrire : il suffit de la composer naturellement telle que vous l'auriez fait si vous ne saviez pas qu'il faut l'optimiser ! Cela peut paraître stupide, mais les meilleures pages sont celles contenant des phrases bien construites, avec bien sûr vos mots-clés. Par contre évitez les listes de mots-clés, cela ne fait pas très sérieux pour le visiteur, et si un robot d'indexation tombe dessus, vous risquez d'être détecté et par conséquent blacklisté !

Google vient d'annoncer un de ses changements les plus importants depuis son lancement : la recherche universelle (Google Universal Search ou Blended Search). En quelques mots : au lieu d'afficher uniquement des résultats issus de la recherche web classique (des pages web au format texte ou assimilé), Google affiche désormais aussi des résultats issus de ses moteurs de recherche spécialisés (dits verticaux) comme par exemple l'actualité, les images ou les vidéos (et bien d'autres services de recherche Google).

Prise en compte de la mise en page HTML par les moteurs de recherche

Après Microsoft et Google, c'est au tour de Yahoo de faire parler de lui au sujet de l'analyse de la mise en page des sites Internet disséqués par son robot d'indexation. Cet article résume les techniques décrites par ces 3 moteurs de recherche...

A l'occasion de la publication des résultats d'une étude sur le suivi du regard (Eye Tracking ou plus savamment oculométrie), je vous livre ici une petite synthèse de ce qu'il faut connaître à ce sujet. Quel est le rapport avec le référencement ? Savoir comment les internautes lisent à l'écran (notamment les pages de résultats des moteurs) s'avère assez utile...

Certaines pages web comportent des liens dits nofollow, qui ne sont pas pris en compte par les moteurs de recherche. Si un partenaire de référencement vous fait un lien mais qu'il met l'attribut nofollow, il vaut mieux vous en rendre compte car il ne vous aidera pas du tout (mis à part le trafic) ! Voici comment détecter ce type de lien en modifiant automatiquement leur apparence dans Firefox...

Commençons par présenter rapidement ce que sont les frames (ou cadres en français). Il s'agit d'un système qui permet d'afficher plusieurs pages indépendantes dans une même fenêtre de votre navigateur. De cette manière, une page peut être affichée en haut de la fenêtre du navigateur et une autre dans la partie basse, cette dernière contenant du texte que vous faites défiler avec l'ascenseur.

En général on utilise les frames pour afficher une zone de menu qui ne bouge pas et qui reste toujours visible à l'écran, tandis que le reste de la page est affiché dans une zone que l'on fait défiler. En cliquant sur les liens de la page du haut, seule la page du bas change, ce qui évite d'avoir à recharger la zone de menu.

Ce dossier reprend l'historique du moteur de recherche Exalead, un moteur de recherche français destiné aussi bien aux particuliers qu'aux entreprises.

TrustRank est à la fois le nom d'un algorithme cherchant à réduire le spam dans les moteurs de recherche et une marque déposée par Google en Mars 2005 (la marque est précisément Trust Rank en 2 mots). Le TrustRank est-il censé remplacer le fameux PageRank ? Difficile de savoir pour l'instant ce que Google veut faire du TrustRank. Voici en attendant d'y voir plus clair une description de l'algorithme du TrustRank.

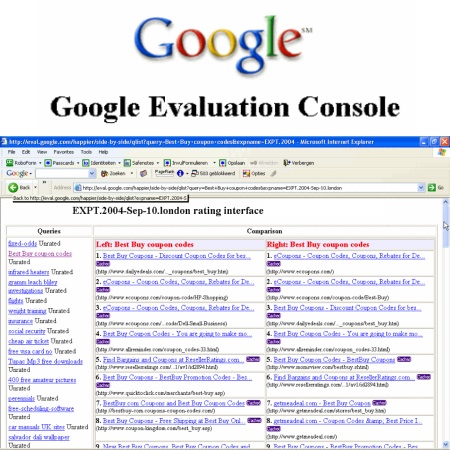

Nous connaissons tous les fameux laboratoires de Google... mais il semblerait qu'il y en ait d'autres tenus secrets. C'est en tout cas de cette façon que Henk van Ess présente des informations très intéressantes sur ce qui ressemble fort à un laboratoire d'évaluation (humaine) de l'algorithme de Google.

Saviez-vous que Google gérait un bac à sable ? C'est en tout cas le terme utilisé par les anglo-saxons (sandbox) pour désigner une nouvelle forme de filtrage ou de pénalité qui touche des sites sur Google.

Dans le cas qui nous intéresse, la syndication de contenu correspond à la mise à disposition par un éditeur de site web d'une sorte de résumé des dernières mises à jour effectuées sur son site, de façon que d'autres éditeurs puissent intégrer ce résumé sur leur site ou le consulter à l'aide d'un logiciel spécifique (appelé "agrégateur" ou lecteur de flux).

L'exemple le plus courant est celui d'un site d'actualités qui propose sous la forme d'un fichier XML la liste des derniers messages d'actualité (titre + introduction + lien vers l'article). Les formats les plus courants sont RSS et Atom. On appelle ça un flux de syndication ou aussi un fil RSS / Atom.